乾元BigBangTransformer是什么?

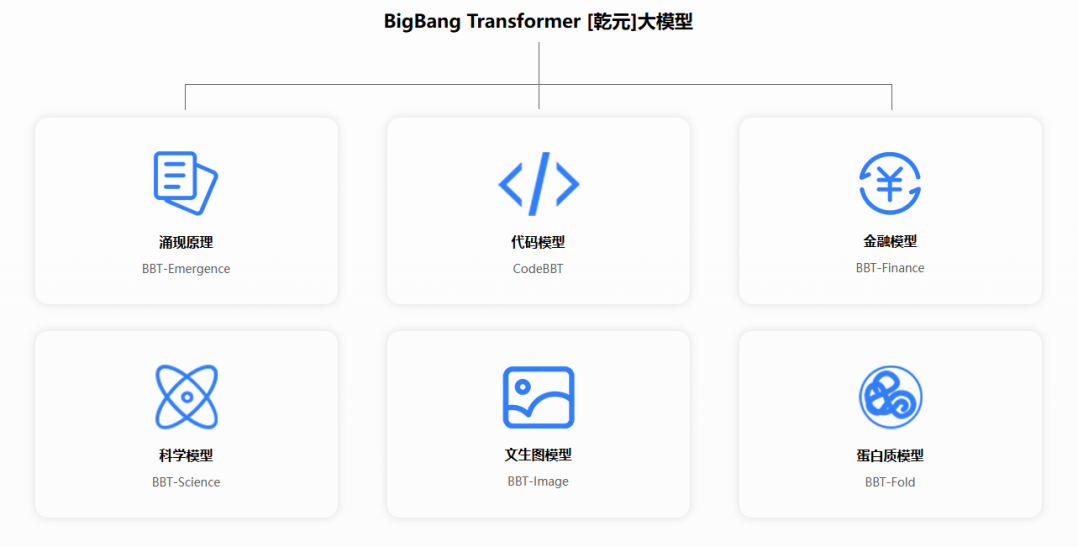

乾元BigBangTransformer(简称BBT)是一系列基于GPT Decoder-only架构的大规模预训练模型。这些模型专为处理和理解自然语言设计,能够执行多种语言相关的任务,包括但不限于对话生成、文本摘要、翻译等。

主要特点:

大规模预训练:BBT模型使用高达2000亿tokens的语料库进行预训练。多语言支持:包括中文和英文在内的多语言处理能力。开源:模型代码和权重向社区开放,便于开发者使用和进一步研究。微调能力:模型可以通过指令微调来适应特定的下游任务。

主要功能:

对话生成:BBT模型能够生成连贯和相关的对话文本。文本理解:模型能够理解和回答基于文本的问题。自定义训练:开发者可以使用自己的数据对模型进行进一步的训练和微调。多领域应用:模型可以应用于金融、新闻、社交媒体等多个领域。

使用示例:

假设你是一名金融分析师,你可以使用BBT模型来:

自动生成市场分析报告的草稿。对财经新闻进行情感分析,以预测市场趋势。通过微调模型来理解特定的金融术语和概念。利用模型的对话能力与客户进行自动化交流。

总结:

乾元BigBangTransformer是一系列功能强大的预训练语言模型,它们通过大规模数据训练,具备了优秀的语言理解和生成能力。模型的开源特性为开发者提供了灵活性,使其能够根据不同的应用场景进行定制和优化,推动自然语言处理技术的发展和应用。

数据评估

关于乾元BigBangTransformer特别声明

本站链一链导航提供的乾元BigBangTransformer都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由链一链导航实际控制,在2024年12月20日 下午4:36收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,链一链导航不承担任何责任。

相关导航

暂无评论...